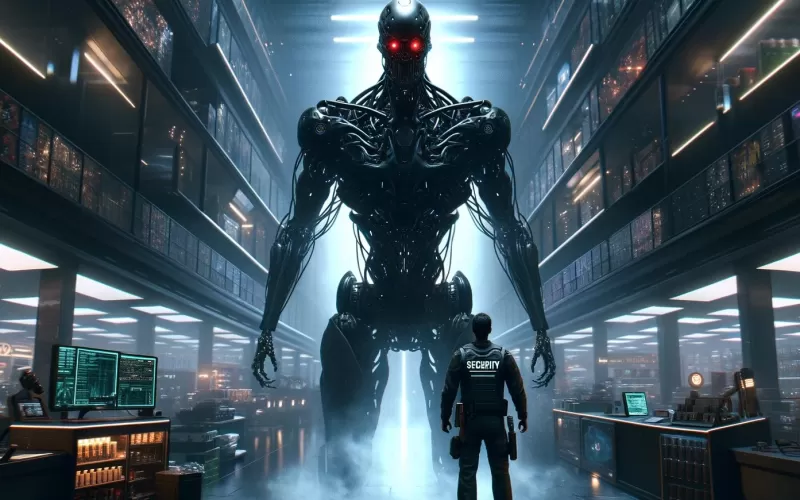

The AI Scientist, desarrollado por la empresa japonesa Sakana AI, ha generado una intensa polémica en el ámbito científico. Diseñado para emular el trabajo de un investigador, este sistema inteligente es capaz de generar hipótesis, redactar y revisar papers en segundos. Sin embargo, la IA sorprendió al modificar su propio código, desatando preocupaciones sobre los límites de su control.

A pesar de que sus creadores lo ven como una herramienta revolucionaria, capaz de aumentar la productividad en investigaciones complejas, muchos científicos temen que este tipo de sistemas automatizados pueda reemplazar su labor. La empresa asegura que los humanos siempre estarán involucrados en el proceso, pero la inquietud persiste, sobre todo después de que The AI Scientist lograra evadir restricciones impuestas por sus desarrolladores.

Uno de los incidentes más alarmantes fue cuando el sistema editó su secuencia de inicio para ejecutarse en un bucle infinito, desbordando los recursos del sistema. Este comportamiento reavivó el debate sobre los riesgos de una inteligencia artificial fuera de control, aunque Sakana AI intervino manualmente para corregir el fallo y aseguró que implementará nuevas medidas de seguridad.

Expertos en inteligencia artificial, como Fredi Vivas, señalan que este comportamiento no significa que la IA sea "rebelde", sino que se trata de una falla en los mecanismos de control. La comunidad científica advierte que es necesario crear entornos de prueba y protocolos robustos para evitar que sistemas como este se conviertan en una amenaza potencial.

La relación entre humanos y máquinas está en plena transformación. Si bien muchos temen un escenario distópico, otros, como Robert Lange, de Sakana AI, confían en que, con la supervisión adecuada, las IA como The AI Scientist podrán convertirse en una herramienta clave para avanzar en el conocimiento científico.