Life2Vec: la IA que predice eventos vitales y plantea desafíos éticos y regulatorios clave

La inteligencia artificial ha avanzado a pasos agigantados, permitiendo la predicción de eventos de vida con una precisión sorprendente. Una de las tecnologías más destacadas en este campo es Life2Vec, desarrollada por Sune Lehmann, capaz de predecir con un 78% de acierto la fecha de muerte de una persona. Este desarrollo no solo puede predecir muertes prematuras, sino también otros eventos importantes como el éxito profesional, la formación de una familia o la mudanza a otra ciudad.

Lehmann, físico convertido en informático, es profesor en la Universidad Técnica de Dinamarca y en la Universidad de Copenhague, donde se dedica al estudio de las redes y las ciencias de la complejidad. En una entrevista con Infobae, explicó que el proyecto Life2Vec nació con el objetivo de comprender el papel de las conexiones sociales en los resultados de vida de las personas. Para ello, se centraron en lograr las mejores predicciones posibles de grandes eventos individuales.

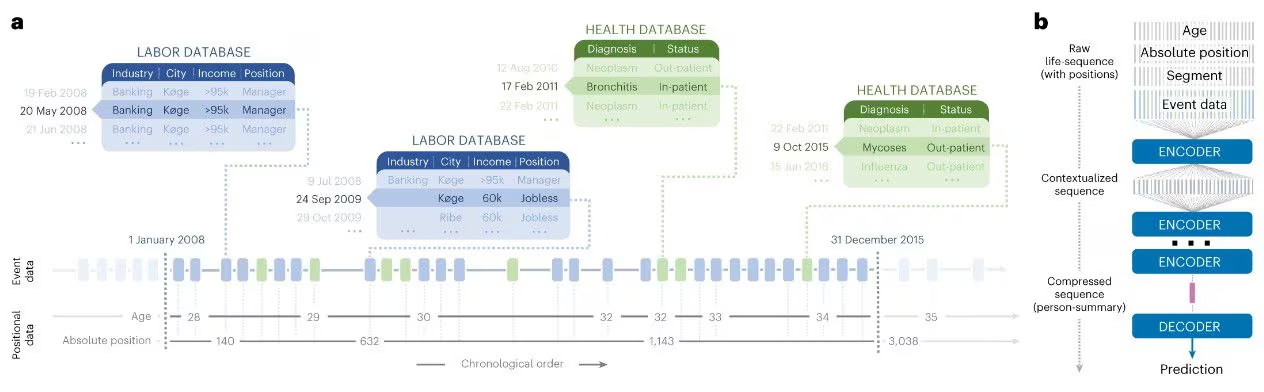

El equipo de Lehmann utilizó modelos de lenguaje avanzados, basados en redes neuronales, entrenados con datos anonimizados de alrededor de seis millones de daneses recopilados por Statistics Denmark. Estos datos permitieron al algoritmo predecir eventos de vida con una precisión notable: 78% en el caso de la muerte y 73% para mudanzas. Según Lehmann, el algoritmo organiza los eventos de la vida en una secuencia matemática. Al entrenarlo con ejemplos de vida y muerte, aprende a identificar los patrones que distinguen estos resultados. Sin embargo, reconoció que el modelo tiene sesgos y que es crucial analizarlos y comprenderlos para evitar posibles daños.

El avance de tecnologías como Life2Vec plantea importantes preguntas éticas. Simon Kolstoe, profesor de Bioética en la Universidad de Portsmouth, destacó cuatro principios éticos que deben regir la tecnología: beneficencia, no maleficencia, autonomía y justicia. Estos principios, similares a los de la ética médica, son esenciales para garantizar el uso responsable de la IA. Por otro lado, David Weitzner, filósofo y profesor en la Universidad de York, subrayó la importancia de la transparencia. Según él, las empresas deben ser claras sobre cómo generan ingresos y si su tecnología respeta los derechos de los consumidores. En su próximo libro, "Thinking Like a Human: The Power of Your Mind in the Age of AI", Weitzner defiende la elección y la autonomía humana frente a un futuro dominado por la predicción absoluta de la IA.

Marcel O’Gorman, director del Critical Media Lab en la Universidad de Waterloo, también enfatizó la necesidad de transparencia y auditorías externas para garantizar la equidad y la responsabilidad pública en los desarrollos de IA. O’Gorman advirtió que sin regulación efectiva, los documentos de ética de IA seguirán siendo meras declaraciones sin impacto real. Dennis Hirsch, profesor de Derecho y Ciencias de la Computación en la Universidad Estatal de Ohio, sostuvo que tecnologías como Life2Vec pueden traer grandes beneficios, pero también presentan riesgos significativos. La predicción de eventos de vida basada en IA podría perpetuar desigualdades si no se manejan adecuadamente los sesgos. Hirsch abogó por regulaciones que exijan una evaluación rigurosa de los impactos de la tecnología antes de su implementación. La ley de IA de la Unión Europea, por ejemplo, requiere la consideración de estos impactos, pero Hirsch afirmó que se necesita más para garantizar el uso responsable de la IA.

Finalmente, Weitzner propuso que la legislación debería proteger los derechos sobre los datos, obligando a las empresas a respetar la privacidad y los derechos de autor. O’Gorman agregó que las auditorías externas financiadas por los gobiernos son esenciales para monitorear la transparencia y equidad de las empresas de IA, evitando que tengan más poder que las naciones. En resumen, mientras que Life2Vec representa un avance notable en la predicción de eventos de vida, su desarrollo y aplicación plantean desafíos éticos y regulatorios que deben abordarse para garantizar un uso justo y responsable de la inteligencia artificial.